5 claves en la investigación del atropello a una mujer por el Volvo autónomo Uber

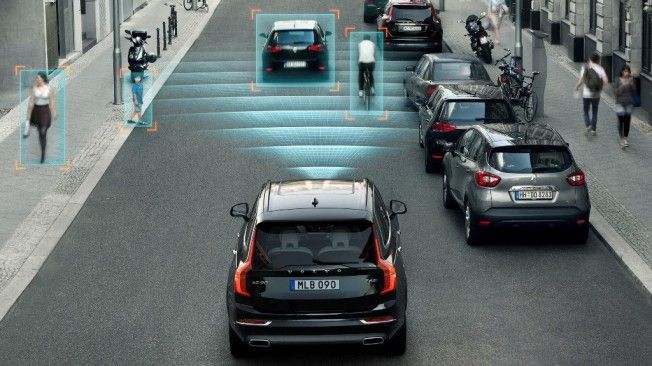

Continua la investigación para aclarar por qué un Volvo XC90 que realiza pruebas de conducción autónoma para Uber no fue capaz de esquivar un peatón que se puso por delante. Los indicios de momento apuntan a un fallo humano, no tecnológico.

La semana pasada se produjo el primer accidente en el que se ve implicado un coche autónomo y hay una víctima mortal. Elaine Herzberg, de 49 años, fue arrollada por un Volvo XC90 que realiza pruebas de conducción autónoma para la empresa Uber. Detrás del volante del XC90 había, como siempre, un conductor supervisando el proceso. En este caso, conductora, Rafaela Vásquez.

Mientras avanza el desarrollo de la investigación, los indicios apuntan a que el accidente no se habría podido haber evitado de haber ocurrido lo mismo con un conductor totalmente concentrado en la labor de conducir, aunque es probable que sus consecuencias hubiesen sido un poco menos dolosas.

Hagamos un repaso.

1) El coche circulaba a velocidad correcta

El XC90 circulaba por una vía de cuatro carriles a una velocidad de 40 millas/hora (65 km/h), que está por debajo de los 73 km/h que limitan ese tramo de carretera mediante señal. El modo autónomo siempre trata de mantener los límites de velocidad como una de sus normas de funcionamiento.

Sin embargo, 65 km/h es una velocidad muy elevada para embestir a un peatón, ya que las posibilidades de supervivencia son prácticamente nulas. Por ese motivo, en las zonas urbanas suele haber un límite de 50 km/h o 35 millas/hora (56 km/h).

2) La víctima cruzó por un lugar no habilitado

Analizando el vídeo que se graba durante las pruebas, resulta evidente que la víctima cruzó por un lugar no habilitado e insuficientemente iluminado. Según la jefa de policía de Tempe (Arizona), la señora Herzberg apareció "de la nada", por lo que apenas hubo tiempo para reaccionar para una máquina. Por lo visto la intersección es confusa en su señalización, según un tuitero.

Si ya cruzar por un lugar no habilitado es peligroso, más lo es no mirar por lo menos si es posible cruzar. Sin embargo, esa circunstancia no basta para eximir responsabilidades, de acuerdo a Janette Sadik-Khan, antigua comisaria del departamento de transporte de la ciudad de Nueva York y consultora en temas de movilidad.

3) El sistema de seguridad de serie estaba desconectado

De serie, los Volvo XC90 cuentan con un sistema de seguridad denominado City Safety. Según el fabricante, primero avisa al conductor y aplica parcialmente los frenos si se detecta un peligro, pudiendo evitar la colisión por completo a una velocidad de 45 km/h. A mayor velocidad, puede atropellar a alguien, pero de forma menos fuerte.

Zach Peterson, un portavoz de Aptiv, fabricante del sistema de seguridad dependiente de Delphi, ha aclarado que dicho sistema se encontraba desactivado en el momento del accidente. Uber está desarrollando su propia tecnología de frenado automático, por lo que mantener el sistema de serie podría provocar algún conflicto. Es el sistema de Uber el que ha fallado en todo caso, no el de serie.

4) La conductora de pruebas iba distraída, pero...

Rafaela Vásquez se encontraba al volante en el momento del accidente, pero no conduciendo, sino supervisando. Inicialmente se informó que era un varón, Rafael. Los medios han indagado en su pasado y cumplió condena por intento de atraco a mano armada, pero está completamente limpia y esa circunstancia es irrelevante.

En el vídeo que filma al conductor se puede apreciar cómo Rafaela no tenía en ese momento los ojos en la carretera, lo cual puede explicarse por la monotonía del trabajo, la aparente falta de peligro en ese tramo.

De todas formas, de haber estado completamente atenta, con tan poco margen de maniobra (la víctima solo aparece un segundo antes) es imposible reaccionar. El tiempo de reacción estándar es de 0,75 segundos, y el coche no frena en el acto.

5) De momento no se puede decir que sea una tecnología insegura

El tan cacareado y aireado accidente hace dos años de un Tesla Model S con el autopilot activado, que provocó la muerte del conductor, Joshua Brown, resultó ser una simple negligencia del mismo. Por un lado, el sistema Autopilot de Tesla es semiautónomo, exige los ojos en la carretera, por otro, no estaba diseñado para circular por una vía con intersecciones al mismo nivel. La víctima iba viendo una película.

En marzo de 2017 hubo un accidente leve con un Volvo XC90 de Uber. La investigación demostró que no fue un error del sistema autónomo, sino de otro conductor. También hubo otro accidente leve en febrero, pero no se pudo demostrar la culpabilidad de ninguna de las partes.

Por lo tanto, los datos son claros: en relación a la distancia recorrida, y excluyendo los errores de los demás, es una tecnología segura, por muy inmadura que esté según ciertos opinadores y demás "expertos". Los conductores humanos no lo hacen mejor.