Lecciones sobre responsabilidad de coches autónomos tras el accidente mortal del Volvo XC90 autónomo de Uber

El gigante tecnológico ha asumido por su cuenta las consecuencias de haber atropellado a una mujer por uno de sus coches autónomos en pruebas. Se sienta un precedente que puede condicionar el desarrollo de la tecnología y de la propia legislación.

Hace dos semanas, fue atropellada una mujer en Tempe (Arizona, EEUU) por un Volvo XC90 que realiza pruebas de conducción autónoma para Uber en ese país. Las circunstancias del accidente son una mezcla de mala suerte y sendos fallos humanos: de la víctima, por cruzar por donde no debía, y de la conductora/supervisora humana, que no iba pendiente.

La familia de Elaine Herzberg, la mujer de 49 años que falleció a causa del atropello, puso una demanda contra Uber a travéz de un bufete de abogados de Glensdale, en el mismo estado. En EEUU es muy frecuente el uso de demandas contra particulares o empresas, aunque el informe de la autoridad competente, la Junta Nacional de Seguridad del Transporte (NTSB), no está terminado.

Uber ha llegado a un acuerdo extrajudicial con la familia, y como suele suceder en estos casos, los términos quedan en secreto. Es un eufemismo de que Uber habrá soltado unos cuantos millones de dólares para evitar que litiguen y se genere un problema de imagen más gordo para la firma de transporte y servicios digitales.

Investigadores del NTSB trabajan en determinar la causa por la cual el XC90 autónomo no intentó ni frenar

Cristina Perez Hesano, abogada del bufete Bellah Perez, se limitó a declarar que el asunto ya se había resuelto, informó Reuters, y no entró en detalles. Es la primera vez que una empresa se tiene que hacer responsable de un fallecido por uno de sus coches autónomos, y la legislación todavía no es clara al respecto.

Podría pensarse en un primer momento que la parte culpable sería la conductora, Rafaela Vásquez, que se supone debía supervisar la conducción autónoma y tomar los mandos del coche a la menor incidencia o fallo de la parte automática. En ese momento iba distraída, seguramente mirando un móvil, tenía la mirada baja, tal y como revela el vídeo de seguridad interior.

Aparentemente, era un tramo sin ningún riesgo

Uber evita un problema doble, y es que la señora Vásquez contaba con antecedentes penales por intento de atraco a mano armada. Ya rindió cuentas ante la sociedad, cumplió condena y estaba completamente "limpia" desde 2005. Haber tenido que asumir la responsabilidad le habría arruinado probablemente la vida. Eso tranquilizará a los cientos de conductores que trabajan en el programa autónomo de Uber.

Rafaela Vásquez

Quizá más de uno se acuerde de que fue precisamente Volvo el primer fabricante que dijo que asumiría la responsabilidad de lo que ocurriese si uno de sus coches se ve implicado en un accidente circulando en modo autónomo. En esta ocasión, eso no rige, ya que no es el sistema de Volvo el que gobernaba el vehículo, sino el de Uber.

Los proveedores ya echaron balones fuera

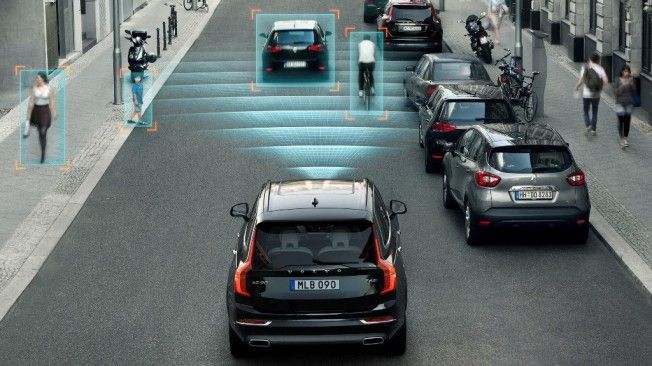

Aptiv, dependiente de Delphi, es proveedor de los sistemas de seguridad de serie del XC90, concretamente el City Safety, que se supone que podría haber detectado a Elaine antes de ser visible y evitar el atropello, o embestirla a una velocidad inferior, pero compatible con la vida. El sistema de serie estaba desconectado, luego no tiene responsabilidad.

También se ha lavado las manos Nvidia, colaborador tecnológico de Uber, argumentando que Uber ha estado utilizando su propia tecnología autónoma, no la de Nvidia, denominada "DRIVE". Dicha tecnología se está utilizando por 370 empresas que están investigando sobre la conducción autónoma.

Tecnología City Safety de Volvo y Aptiv/Delphi

Este accidente ha venido antes de que la legislación sea completamente clara en cuando a quién ha de asumir la responsabilidad por daños a terceros mientras un vehículo autónomo funciona por su cuenta. Los legisladores, como no espabilen, retrasarán el despliegue de esta tecnología, pues los fabricantes no querrán asumir varias posibles demandas o, peor aun, demandas colectivas (class action suit).

Tanto Uber como Nvidia pararon por cautela sus pruebas de conducción autónoma en todo el país, al menos hasta que se sepa qué ha fallado. El vehículo autónomo en cuestión no intentó frenar, se llevó por delante a Elaine a una velocidad de 65 km/h. Ese impacto es mortal de necesidad, aunque no falleció en el acto.

¿Quién tendrá que hacerse cargo en el futuro de estos daños? ¿La compañía de seguros? ¿El fabricante? ¿El proveedor de componentes (sensores o actuadores)? ¿El conductor del programa de pruebas, si lo hay? ¿Qué pasará cuando el vehículo lleve a personas incapacitadas para conducir -en modo 5, 100% autónomo- como invidentes, ancianos, niños, enfermos o minusválidos?